重组肉是指通过机械和添加辅料使肌肉中的肌原纤维蛋白析出,然后利用添加剂的黏合作用使肉糜、肉颗粒或肉块重新组合,经冷冻后直接出售或经预热处理保留和完善其组织结构的肉。在我国重组肉种类较多,如重组牛排、培根等,产量也极大。碎肉块经过黏合剂及香精、香料处理后,具有口感丰富、肉质鲜嫩等特点[1]。目前,由于国内市场上存在重组肉及其制品生产标准不够完善、相关监管部门的管理力度欠缺等问题,导致一些不法生产者在实际生产中为牟取利益,用劣质碎肉原料取代优质原料,严重者直接以低价肉取代高价肉,如以碎鸭肉添加香精、香料仿制重组牛排,不仅损害了消费者利益,而且对市场的良性发展造成极大的安全隐患[2-3]。因此建立快速、准确识别重组碎肉的方法,对规范市场秩序和指导消费者准确选购均具有重要意义。

目前,国内外关于重组肉的研究主要集中在完善重组加工技术[4]、优化辅料添加量[5-6]以及消费者对重组肉态度的调查研究[2],而如何快速、准确地辨识重组肉的研究却鲜少涉及。常见的感官评价技术虽然可以快速识别重组牛肉,但受到样品相似度及感官评定员生理状态等因素的影响,可能会存在主观性较强、重复性低等问题,从而影响检测结果的准确性。一些新兴技术,如近红外光谱成像技术[7]、多光谱成像技术[8]、高光谱成像技术[9]等也应用到肉类掺假检测中,但这些方法存在检测设备造价昂贵、对操作人员技术要求较高等问题。而机器视觉技术只需利用图像传感器获取物体的图像,再将图像转换成数字信息,并利用计算机模拟人的判别准则去识别图像,从而作出优于人眼的客观评定,具有识别速度快、准确率高及无损检测等特点[10],被越来越多地应用到食品科学研究中,如肉类新鲜度[11]、肌内脂肪含量[12]、系水力[13]及嫩度[14]的相关研究,并且可通过智能手机实现在线实时图像识别[15],其中支持向量机(support vector machines,SVM)[16-19]、LeNet-5卷积神经网络[20-22]等方法已经成为提取图像视觉特征的主流方法,在食品图像检索和分类任务中,识别性能高、重复性好,可以运用到食品检测等方面。

本研究构建基于卷积神经网络的3 种深度残差网络(deep residual network,ResNet)模型(ResNet-50、ResNet-101、ResNet-152),以纹理特征作为模型的识别标签,并以准确率为主要评价指标,辅以测试所需时间对比,将3 种ResNet模型(ResNet-50/101/152)与视觉几何群网络(visual geometry group network,VGG)16、SVM、LeNet-5卷积神经网络3 种模型识别进行对比分析,对重组牛肉进行客观、准确、快速识别,提供一种快速识别重组牛肉的方法。

1 材料与方法

1.1 材料

牛肉样品购自辽宁省某食品公司,牛品种为利木赞牛与鲁西黄牛的杂交牛,24~36 月龄,育肥6 个月以上,体质量400~550 kg。屠宰前禁食24 h,禁水8 h,电击晕后屠宰,冷却排酸24 h,从宰后成熟胴体中选取眼肌部分制作实验样品,在4 ℃条件下切割后(15 cm×10 cm×2 cm)立刻拍照采集数据。

重组牛肉以重组牛排作为研究对象,购自当地万达超市(由河南伊赛牛肉股份有限公司经由冷链运输至万达超市)。在4 ℃条件下解冻至表面无霜后拍照采集照片。

1.2 仪器与设备

EOS-M5照相机 日本佳能公司;Y7000P笔记本电脑 中国联想公司;VGA2USB图像采集卡 加拿大艾普飞公司;LED迷你小型摄影棚 深圳市胖牛科技有限公司。

1.3 方法

1.3.1 样品图像采集

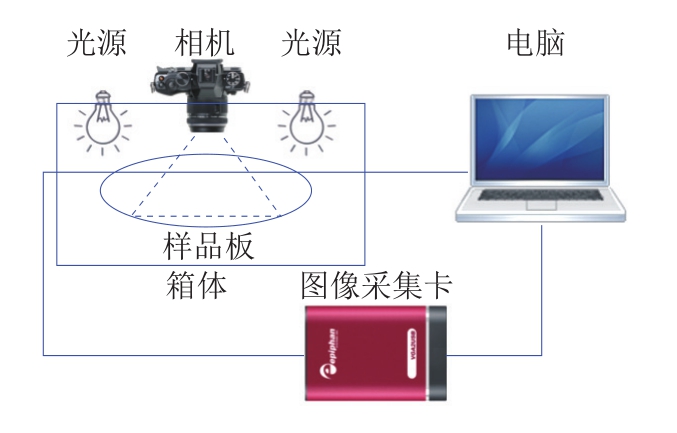

本研究的样品图像均在设计的图像采集装置下采集,图1为图像采集装置的结构示意图。该图像采集装置主要由摄影棚(含光源和白色亚光样品板)、照相机、图像采集卡及电脑组成,其中光源、照相机及样品板固定在黑色箱体内[23-24]。具体采集过程如下:将装置放置于水平工作平台,调整相机镜头与样品表面的距离,开启设备,采集图像,采集后的图像经由图像采集卡传入电脑,数据通过基于Python平台编写的图像处理程序进行分析。

图1 图像采集装置示意图

Fig.1 Schematic diagram of the image acquisition device

1.3.2 基于多层次的卷积神经网络图像识别模型构建

本研究所涉及的数据分析工作均在Python 3.5(64bit)平台上完成,主要使用开源的第三方Python扩展模块配合计算和绘图,其中“Pylab”模块用于绘制二维、三维图像,“Numpy”和“Matplotlib”模块用于数据统计,“Keras”、“TensorFlow”和“OpenCV”模块用于机器学习和最优化计算。本研究基于ResNet方法的图像检索和分类方法如图2所示。

图2 基于ResNet的牛肉图像检索和分类方法

Fig.2 Flowchart of ResNet based beef steak image retrieval and classification

输出图像大小(OutputSize)按式(1)计算。

式中:ImageSize为输入图像大小;KernelSize为卷积核大小;Stride为卷积核步长(默认为1)。

模型最后的神经元输出经过SoftMax回归后得出2 种概率分数,分数最大的节点就是测试结果,神经元节点1代表非重组样品的概率,神经元节点2代表重组样品的概率。例如,神经元节点1的输出为0.89,神经元节点2的输出为0.11,故选取神经元节点1作为最终结果,即该图的分类结果为非重组样品[25]。损失函数用于衡量神经网络模型预测结果与实际值之间的误差距离,预测结果与实际值越接近,说明模型的拟合能力越强,对应损失函数的结果就越小;反之损失函数的结果越大。基础损失函数有2 种,分别为用于解决分类任务的交叉熵损失函数和用于解决回归任务的均方误差(mean square error,MSE)损失函数。本研究采用的MSE损失函数如式(2)所示。

式中:n为1 批数据中的样本数;y为期望输出;y’为实际输出。

1.3.3 图像预处理

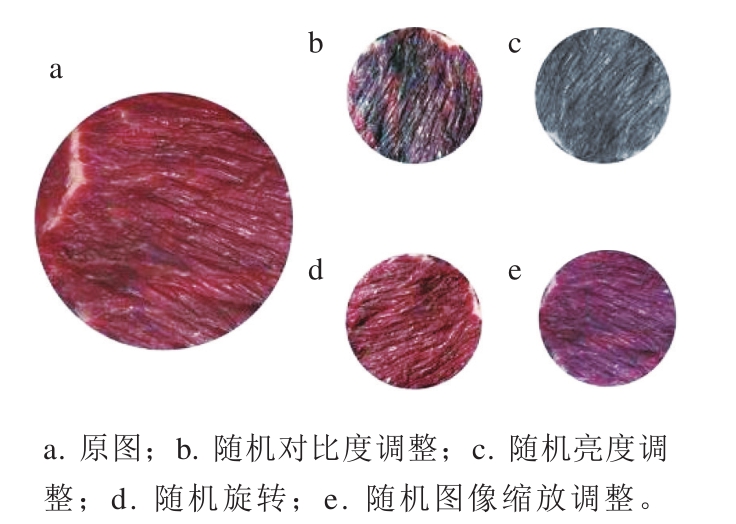

数据采集时为避免样本的色差、大小及形状等对训练模型的干扰,对采集的1 542 张图像进行4 种方式的图像预处理:随机对比度调整、随机亮度调整、随机旋转、随机图像缩放调整[26]。

1.3.4 图像特征提取

基于卷积神经网络进行机器学习,需要寻找到图像的特征作为识别标签,如颜色、形状等,从而确定下一步的模拟运算方向。在这一进程中,需要选定识别标签,帮助模型更精确地定位到具体特征位置。通过对大量图片的对比研究发现,重组牛肉与非重组牛肉颜色虽然存在些许差异,但牛肉冷藏过久色泽也会发生改变[23],因此在难以确定部分牛肉具体贮藏时间的情况下,颜色很难作为判断的重要标准。由于重组牛肉的肌肉纹理不自然且不均匀,因此本研究以纹理特征作为模型的识别标签[27-28]。

1.3.5 图像特征可视化

由于卷积神经网络的特点,各层特征图不具备正常图像所拥有的可视化过程,故将每个特征矩阵归一化至整型闭区间[0,255]内,0为蓝色,255为黄色,中间序列作为渐变颜色进行填充,构建出各个层输出的特征图。采用ResNet方法,在每层卷积神经网络之间均添加批量标准归一化模型,用于平衡特征图各点的响应,且所有卷积模型均采用Adam优化函数作梯度下降任务。除最后一层外,其他所有神经元层均添加L2正则惩罚,VGG模型每层卷积后均添加Batch normalization函数,用于避免过拟合,网络深度分别为50、101、152 层[29]。

1.3.6 训练集参数设置

在利用数据对机器学习模型进行训练之前,需对ResNet模型进行参数设置:最大执行步数50 000、每步使用的1 批数据样本数为64、学习率0.001、固定学习率0.041、优化器使用rmsprop、指数衰减度为0.98、模型中L2正则化超参数为0.000 1,在训练集训练得到Loss值的变化趋势[30]。

1.3.7 模型评估指标

评估机器视觉模型识别效果的指标主要包括测试集准确率、误差率及所需时间等,本研究目的在于快速、准确辨识重组牛肉与非重组牛肉,因此以测试集准确率为主,辅以测试所需时间作为评估ResNet-50、ResNet-101、ResNet-152、VGG-16、SVM和LeNet-5模型辨识重组牛肉与非重组牛肉的主要指标。

2 结果与分析

2.1 图像采集结果

共采集到样品照片1 542 张,在此基础上,采用1.3.3节提及的4 种图像预处理方法,最终得到6 168 张样品图像,按约8∶2随机分配训练集和测试集,其中4 936 张作为训练集,用于构建和优化实验模型,剩余1 232 张作为测试集,用于测试模型的准确性。为美化出图效果,样品图像输出调整为圆形。

2.2 图像预处理结果

样品图像经过随机对比度、亮度、旋转和缩放调整等方法预处理后,结果如图3所示。在不改变样品图像本身属性的前提下,随机对比度与随机亮度调整使得样品图像亮度呈现出较大差异,有利于获得大量图像细节信息;经过随机旋转和随机缩放处理后,改变了图像的原有位置、方向和量级,从而生成新的图像,进而增加了样本数量,有利于提升测试结果的准确率。

图3 图像预处理结果

Fig.3 Results of image preprocessing

2.3 图像特征可视化结果

泛化能力强的卷积神经网络的卷积核(感受野)越靠近输入端,其特征图往往与输入图像很相似,随着卷积的不断加深,提取到的特征将会越来越细致。这意味着能够提取到的不同层特征越丰富,准确率可能也就越高。不同深度下的ResNet模型部分层级(1~4 层)的结构可视化结果如图4所示。卷积神经网络的特性之一在于可以自动提取图像数据中的特征,因此分别取出ResNet中的前4 层作可视化,第1层特征图的大小为52×52,从第2层开始特征图的大小分别为:26×26、13×13、11×11。

图4 卷积神经网络的各层可视化图

Fig.4 Visualization of the layers of convolutional neural networks

2.4 训练集识别结果评估及分析

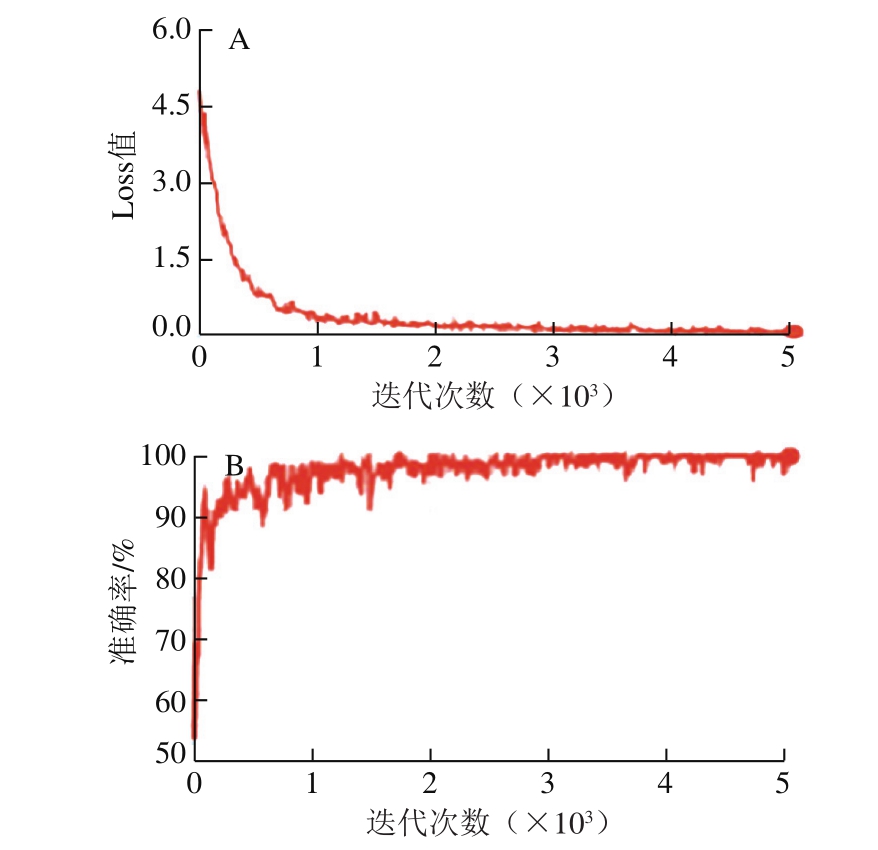

损失函数(Loss值)是评估模型准确率最主要的因素,一般情况下,Loss值越小,则模型准确率越高,研究意义也就越大,因此在其他学习模型参数恒定不变的情况下,追求较低Loss值是保证模型准确率的重要方式[31-32]。

图5 ResNet-50模型在数据集上的训练趋势

Fig.5 Dataset training trend of ResNet-50 model

由图5可知,以ResNet-50模型为例,训练过程中模型均基于1.3.6节所设定的参数。在初始状态下,迭代次数为0,Loss值为4.810,准确率为54%;当迭代次数为4 000时,Loss值降低为0.095,准确率为100%;当迭代次数提高为5 000时,Loss值降低为0.064,准确率为100%。因此,当迭代次数大于4 000时,对训练准确率影响较小,不需要继续迭代,因此将迭代次数定为4 000。

2.5 测试集识别结果评估及分析

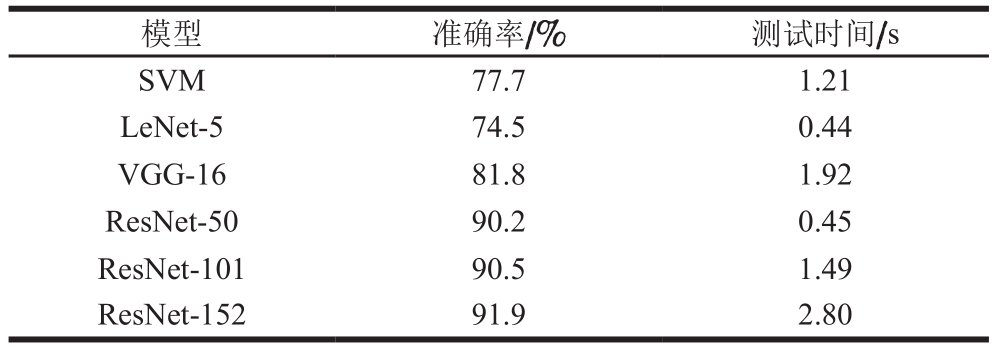

将3 种不同深度的ResNet模型与SVM、LeNet-5、VGG-16模型的准确率进行比较,模型呈现的数据为重组牛肉与非重组牛肉分类的平均准确率和测试所需时间。

表1 不同模型的分类性能比较

Table 1 Comparison of classification performance of different models

模型 准确率/% 测试时间/s SVM 77.7 1.21 LeNet-5 74.5 0.44 VGG-16 81.8 1.92 ResNet-50 90.2 0.45 ResNet-101 90.5 1.49 ResNet-152 91.9 2.80

由表1可知:单独对比准确率发现,LeNet-5模型<SVM模型<VGG-16模型<ResNet-50模型<ResNet-101模型<ResNet-152模型;单独对比测试时间发现,ResNet-152模型>VGG-16模型>ResNet-101模型>SVM模型>ResNet-50模型>LeNet-5模型;综合对比准确率和测试时间发现,ResNet模型准确率明显优于其他3 种模型。在ResNet模型中,深度越深,规模就越大,识别准确率也就越高,但是所需时间也相对较长。本研究中ResNet-50模型的测试时间最短,仅需0.45 s,识别准确率较高,因此选取ResNet-50模型作为识别重组牛肉的主要模型。

3 结 论

本研究将卷积神经网络引入到重组牛肉的图像识别领域中,提出一种基于ResNet模型的识别方法,并将此方法应用到图像识别任务中,结果表明:1)以纹理作为识别重组牛肉的标签,当迭代次数达到4 000时,Loss值降低为0.095,训练集准确率达到100%,3 种不同深度的ResNet(50/101/152)模型测试集的准确率分别达到90.2%、90.5%和91.9%,且继续增加迭代次数对准确率的影响较小,在此条件下,ResNet模型可以实现对重组牛肉与非重组牛肉的准确识别;2)3 种不同深度的ResNet模型在识别准确率方面均优于SVM、VGG-16和LeNet-5模型,但在运算速度上优势不太明显,3 种不同深度的ResNet模型(ResNet-50/101/152)测试时间分别为0.45、1.49、2.80 s,说明ResNet模型可以实现对重组牛肉与非重组牛肉的快速识别。

将基于卷积神经网络的3 种不同深度的ResNet模型应用到重组牛肉与非重组牛肉的图像识别领域,并与SVM、VGG-16和LeNet-5 3 种模型的识别效果进行对比分析,证明ResNet模型可以实现对重组牛肉与非重组牛肉的快速、准确识别,其中ResNet-50模型识别准确率达到较高水平,所需时间最短,可用于快速识别重组牛肉,为今后开发智能识别重组牛肉设备提供了参考。

[1]周亚军, 王淑杰, 闫琳娜, 等.重组鹿肉制品的加工特性[J].农业工程学报, 2008, 24(9): 276-283.

[2]刘兵, 夏秀芳, 孔保华, 等.猪血制备的纤维蛋白原黏结剂对重组牛肉品质的影响[J].食品科学, 2017, 38(13): 125-130.DOI:10.7506/spkx1002-6630-201713021.

[3]马娅俊, 韩玲, 尉莹, 等.不同加工方式对煎制重组牛排食用品质的影响[J].食品工业科技, 2016, 37(18): 302-316.DOI:10.13386/j.issn1002-0306.2016.18.049.

[4]YE X, KENNEDY J F, LI B, et al.Condensed state structure and biocompatibility of the konjac glucomannan/chitosan blend films[J].Carbohydrate Polymers, 2006, 64(4): 532-538.DOI:10.1016/j.carbpol.2005.11.005.

[5]MARTITS J T, CERQUEIRA M A, BOURBON A I, et al.Synergistic effects between κ-carrageenan and locust bean gum on physicochemical properties of edible films made thereof[J].Food Hydrocolloids, 2012, 29(2): 280-289.DOI:10.1016/j.foodhyd.2012.03.004.

[6]LI Xing, JIANG Fatang, NI Xuewen, et al.Preparation and characterization of konjac glucomannan and ethyl cellulose blend films[J].Food Hydrocolloids, 2015, 44: 229-236.DOI:10.1016/j.foodhyd.2014.09.027.

[7]COLLELL C, GOU P, PICOUET P A, et al.Feasibility of nearinfrared spectroscopy to predict aw and moisture and NaCl contents of fermented pork sausages[J].Meat Science, 2010, 85(2): 325-330.DOI:10.1016/j.meatsci.2010.01.022.

[8]LIU Jinxia, CAO Yue, WANG Qiu, et al.Rapid and non-destructive identification of water-injected beef samples using multispectral imaging analysis[J].Food Chemistry, 2016, 190: 938-943.DOI:10.1016/j.foodchem.2015.06.056.

[9]KAMRUZZAMAN M, MAKINO Y, OSHITA S, et al.Parsimonious model development for real-time monitoring of moisture in red meat using hyperspectral imaging[J].Food Chemistry, 2016, 196(3): 1084-1091.DOI:10.1016/j.foodchem.2015.10.051.

[10]MUHAMMAD M, PEEYUSH S.Development of an automatic grading machine for oil palm fresh fruits bunches (FFBs) based on machine vision[J].Computers and Electronics in Agriculture, 2015,44(3): 296-300.DOI:10.1016/j.compag.2013.02.008.

[11]SHI Ce, QIAN Jianping, WU Xiaoming, et al.Developing a machine vision system for simultaneous prediction of freshness indicators based on tilapia (Oreochromis niloticus) pupil and gill color during storage at 4 ℃[J].Food Chemistry, 2013, 93: 129-139.DOI:10.1016/j.foodchem.2017.09.047.

[12]LIU J H, SUN X, YOUNG J M, et al.Predicting pork loin intramuscular fat using computer vision system[J].Meat Science,2018, 143: 18-23.DOI:10.1016/j.meatsci.2018.03.020.

[13]王笑丹, 武瑞玾, 徐丽萍, 等.基于颜色传感器和遗传算法的牛肉系水力快速检测[J].农业工程学报, 2018, 34(11): 293-299.DOI:10.11975/j.issn.1002-6819.2018.11.037.

[14]王笑丹, 刘爱阳, 孙永海, 等.基于自组织神经网络模型与质构特性的牛肉嫩度评定方法[J].农业工程学报, 2015, 31(18): 262-268.DOI:10.11975/j.issn.1002-6819.2015.18.036.

[15]YOSHIYUKI K, KEIJI Y.FoodCam: a real-time food recognition system on a smartphone[J].Multimedia Tools and Applications, 2015,74(14): 5263-5287.DOI:10.1007/s11042-014-2000-8.

[16]SEO J K, BAIK S, LEE S H, et al.Simulating the architecture of a termite incipient nest using a convolutional neural network[J].Ecological Informatics, 2018, 44: 94-100.DOI:10.1016/j.ecoinf.2018.02.003.

[17]王小燕, 王锡昌, 刘源, 等.基于SVM模型的近红外光谱技术在鱼糜水分和蛋白质检测中的应用[J].光谱学与光谱分析, 2012, 32(9):2418-2421.DOI:10.3964/j.issn.1000-0593(2012)09-2418-04.

[18]XU Junli, SUN Dawen.Computer vision detection of salmon muscle gaping using convolutional neural network features[J].Food Analytical Methods, 2018, 11(1): 34-47.DOI:10.1007/s12161-017-0957-4.

[19]王巧华, 王彩云, 马美湖.基于机器视觉的鸭蛋新鲜度监测[J].中国食品学报, 2017, 17(8): 268-274.DOI:10.16429/j.1009-7848.2017.08.036.

[20]ANDEY P, DEEPTHI A, MANDAL B, et al.FoodNet: recognizing foods using ensemble of deep networks[J].IEEE Signal Processing Letters, 2017, 24(12): 1758-1762.DOI:10.1007/s12161-017-0957-4.

[21]FU Zhihui, CHEN Dan, LI Hongyu.A large benchmark dataset for Chinese food recognition[C]//Intelligent Computing Theories and Application: 13th International Conference on Intelligent Computing, Liverpool, UK, August 7-10, 2017: 273-281.DOI:10.1007/978-3-319-63309-1_25.

[22]梅舒欢, 闵巍庆, 刘林虎, 等.基于Faster R-CNN的食品图像检索和分类[J].南京信息工程大学学报(自然科学版), 2017, 9(6): 635-641.DOI:10.13878/j.cnki.jnuist.2017.06.007.

[23]彭增起, 徐幸莲, 周光宏, 等.一种猪肉颜色质量等级的划分方法:CN1751812[P].2006-03-29.

[24]GHASEMI-VARNAMKHASTI M, GOLI R, FORINA M, et al.Application of image analysis combined with computational expert approaches for shrimp freshness evaluation[J].International Journal of Food Properties, 2015, 19(10): 2202-2222.DOI:10.1080/10942912.20 15.1118386.

[25]YU Dingjun, WANG Hanli, CHEN Peiqiu, et al.Mixed pooling for convolutional neural networks[C]//Rough sets and knowledge technology:9th international conference, RSKT 2014, Shanghai, China, October 24-26,2014: 364-375.DOI:10.1007/978-3-319-11740-9_34.

[26]HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al.Deep residual learning for image recognition[C]//Proceedings of the 29th IEEE conference on computer vision and pattern recognition, 2016: 770-778.DOI:10.1109/CVPR.2016.90.

[27]ASMARA R A, ROMARIO R, BATUBULAN K S, et al.Classification of pork and beef meat images using extraction of color and texture feature by grey level co-gccurrence matrix method[J].IOP Conference Series Materials Science and Engineering, 2018, 434(1):012072.DOI:10.1088/1757-899X/434/1/012072.

[28]赵娟, 彭彦昆.基于高光谱图像纹理特征的牛肉嫩度分布评价[J].农业工程学报, 2015, 31(7): 279-286.DOI:10.3969/j.issn.1002-6819.2015.07.039.

[29]李金平.冻藏时间和反复冻融对牛肉品质影响的研究[D].南京: 南京农业大学, 2009: 19-20.DOI:10.7666/d.Y1762744.

[30]SIMONYAN K, ZISSERMAN A.Very deep convolutional networks for large-scale image recognition[C]//The 3rd international conference on learning representations, 2015: 1-14.https://arxiv.org/abs/1409.1556.

[31]RAMCHARAN A, BARANOWSKI K, MCCLOSKEY P, et al.Deep learning for image-based cassava disease detection[J].Frontiers in Plant Science, 2017, 8: 1852.DOI:10.3389/fpls.2017.01852.

[32]黄旭, 凌志刚, 李绣心.融合判别式深度特征学习的图像识别算法[J].中国图象图形学报, 2018, 23(4): 510-518.DOI:10.11834/jig.170336.